はじめに # LangfuseはSelf-Hosted可能で、過去のブログでもご紹介したとおり、Google Cloud上にも簡単にLangfuse環境の構築が可能です。

はじめに # 2025年4月9日、GoogleがAgent2Agent(A2A)プロトコルを発表 してから半年以上が経過し、多くの開発者がマルチエージェントシステムの構築に取り組んでいます。

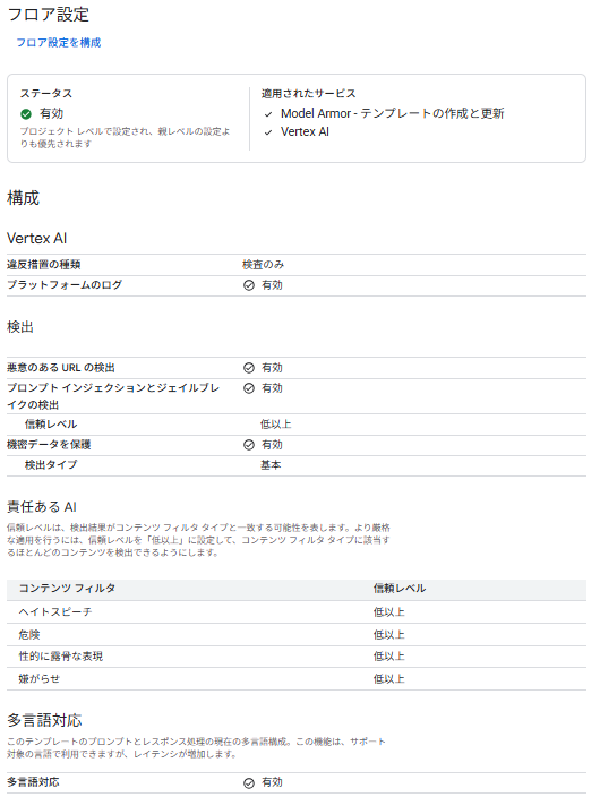

AIアプリのセキュリティ問題について # AIを利用したアプリケーションが急速に普及する一方で、悪意あるプロンプトでAIをハッキングしようとする動きも出てきています。

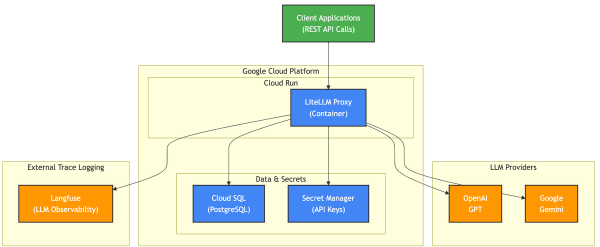

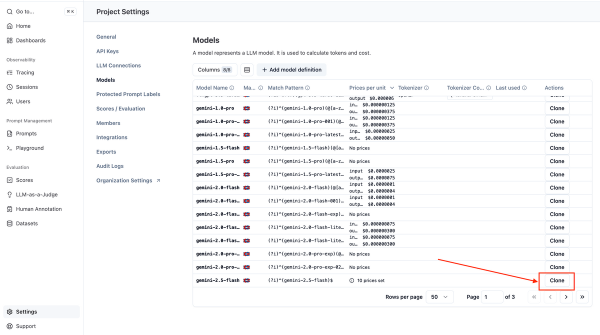

はじめに # 近年、LLMアプリケーションの開発において、複数のLLMプロバイダーを使い分ける必要性が高まっています。 OpenAIのGPT、AnthropicのClaude、GoogleのGeminiなど、それぞれ異なる特徴を持っており、それぞれの特徴に合わせてLLMを使い分けるケースも多くあります。 また、コスト最適化の観点から、簡単なタスクには安価なモデルを、複雑なタスクには高性能なモデルを使い分けることも重要です。

はじめに # GoogleのVertex AI Geminiが提供するコンテキストキャッシュ機能は、大量のコンテキストを再利用することで、APIコストを大幅に削減できる強力なツールです。しかし、実際にどの程度のコスト削減効果があるのかを可視化するには、一手間加える必要があります。

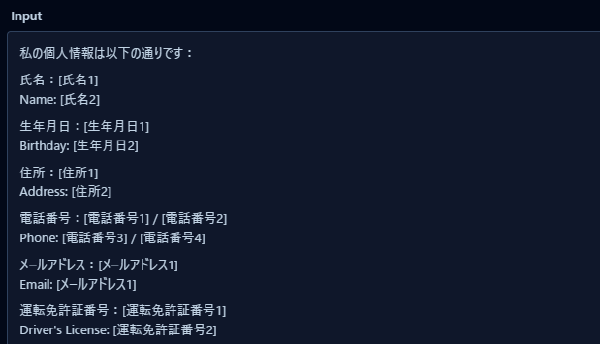

これまで、LangfuseでのPIIマスキング手法として、llm-guard 、Guardrails for Amazon Bedrock 、そしてLLM(Gemini 2.5 Flash Lite) によるマスキング手法を検討してきました。

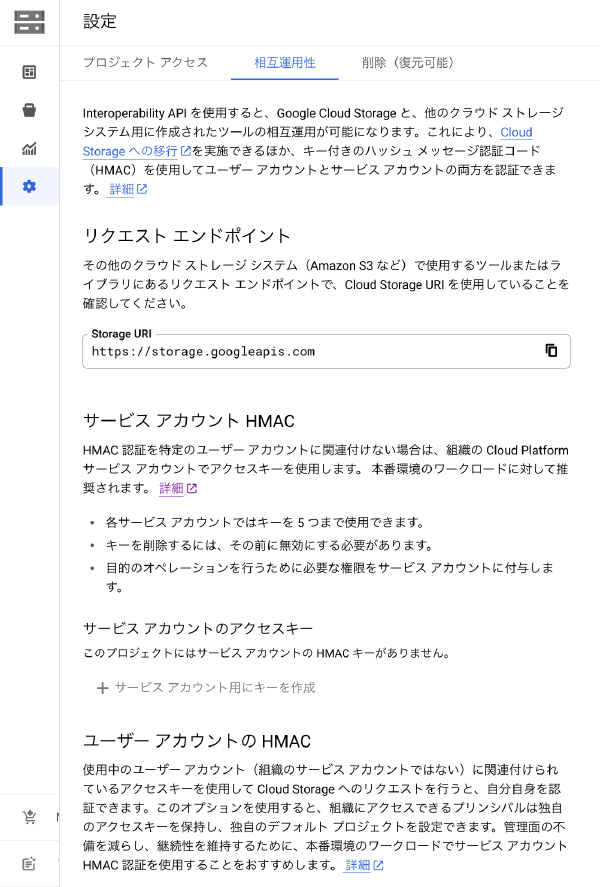

今回は、Google Cloudの機密データ保護機能であるSensitive Data Protection(旧:Cloud Data Loss Prevention, Cloud DLP) の利用について検討します。

LangfuseにおけるPIIマスキング手法の検討 # 前回の記事 では、Guardrails for Amazon Bedrockを利用したPIIマスキングについて紹介しました。個人情報を列挙した形のテストデータにおいては精度が高く、大半の情報は除去できましたが、一部、フィルターが準備されていないなど、追加の対応が必要な項目が残っていました。

はじめに # 本記事では、この Langfuse 環境を Google Cloud 上に構築する方法について解説します

更新日:2025年3月8日

はじめに # GAOの遠矢です。普段はLLMアプリケーションの開発を主にしております。